以下の本を読みます。上巻を読むこともあります。何か問題点がありましたらご指摘いただけますと幸いです。

- 作者: C.M.ビショップ,元田浩,栗田多喜夫,樋口知之,松本裕治,村田昇

- 出版社/メーカー: 丸善出版

- 発売日: 2012/02/29

- メディア: 単行本

- 購入: 6人 クリック: 14回

- この商品を含むブログを見る

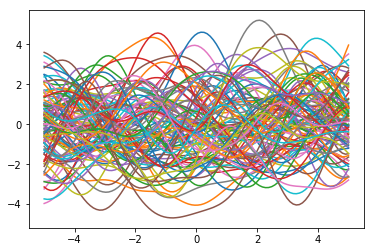

まだ事前分布じゃん! あと本当に2列に分けた意味ないな!

下段真ん中は一番左上の図の分散共分散行列のすべての成分に定数 が加わっています。「近い点どうしは相関は強いはず」に加えて、「全ての点どうしはある程度相関が強いはず」というのが加わった感じですね。なのでサンプルされた点列はプラス側だったら全体的にプラス側、マイナス側だったら全体的にマイナス側に出ていますよね。一番右下は線形項がある場合ですね。1次元の内積なのでただの積ですが…この図の左端と右端の点どうしが一番負の方に相関が強くなるはずですね。なので実際描かれているグラフも両端で符号が逆側になっているのが多いです。ゼロ付近では線形項の効果はあまりなく、両端に行くほど近い点どうしの相関が強くなっていくはずです。定数項と線形項は、(6.63) 式の下にかいてあるように考えている線形基底関数モデルが通常の線形モデルと同じ項をもつようにするためにあるような気がしますけど。

事前分布はもう飽きてきたな。この図 6.5 をどうやって事後分布に更新するの?

は? じゃあ の分布は (6.50) 式の事前分布

のままってこと?

個の観測値が得られたのに重みは更新されないってどういうことだよ? それじゃ

の分布ごちゃごちゃしたままじゃん(下図)。回帰モデルだったら重みを求めるだろ普通。

あ、いえ、 自体を更新してはいないというだけです。

は間接的に更新されています。何も観測していない下での目標変数の同時分布

を既に観測した

で条件付ける形で(式 6.66, 6.67)。しかし、更新後の

の分布は直接あらわれていません。ここから

の分布を逆算することはできるかもしれませんが、する意味もありません。いま興味があるのは

の分布であって、

の分布には正直興味がないんです。

そこまでいうとなんか がかわいそう!

未知の点 に対応する目標変数の予測分布の平均と分散は以下ですね。

うーん、まあ何となくは? あれでもさ、観測値を得る前ってなんか糸くずみたいにごちゃごちゃしてなかった? 上の絵みたいに。こんな帯みたいな感じじゃなくなかった?

糸くずみたいな絵、つまり、さまざまな において同時に取る値のありうるシナリオの1つを描くこともできるはずです。例えば未知の

個の点に対して

の同時分布の共分散行列の分割を行えば

の平均ベクトルと共分散行列が得られます。それさえあればその糸くずみたいな絵を描いたのと同じ要領で

変量正規分布から点をどんどんサンプリングすればいいだけです。もっとも、今度の糸くずみたいな絵は既に手に入っている

個の観測値に寄り添ってまとまってくると思います。計算するの面倒そうですし、それを描いてもさほどありがたくなさそうですが。

でも15ページで散々「関数に対する事前分布」「関数 上での分布」って言って、その事前分布としてガウス過程を導いたんだから、事後分布も関数の分布であってほしくない? このグレーの帯じゃ関数の分布じゃなくて各点での値の分布じゃん。

まあそれはそうですね。

なんか一貫してない気がするんだよな。まあいいけど…あ、そういえばこの21ページの「 が有限の基底関数で定義される場合には、3.3.2 節で得られた、ガウス過程の観点から導いた線形回帰の結果を再び導くことができる」って何だろ。上巻を見なきゃか…あ、今日上巻もってないや。というか下巻だけでも持ち歩くの十分重いんだよな…。

それならもう持ち歩く必要はありませんよ。PRML は先月無料で公開されましたから。

英語じゃん! まあ背に腹は代えられないから読むけど…ってあれ? この 3.1 節の数式いまの状況と同じ…てかこの (3.55) 式、こっちではちゃんと尤度最大化で 求めてるじゃん!

かわいそうじゃない! あ、しかも Figure 3.9 には糸くずみたいな事後分布も載ってる!

なるほど。6.4.2 節ではそもそも を求める必要がありませんでしたが、

に興味があったとしても基底関数が無限にあったら無限次元の

の事後分布をとらえることはできませんでしたね。でも基底関数が有限個なら Figure 3.7 のように

をベイズ更新することができて、

の分布からのサンプリングで Figure 3.9 を描くことも容易(

の分布さえあれば)ですね。

まあそれで無限の特徴を扱えるようになったと思えば…訓練データが大きい場合のための近似手法もあるようですね。

6.4.3 節は、超パラメータの学習? ここでの超パラメータって何?

おそらく観測ノイズの精度 と、(6.63) 式の

などではないでしょうか。

それらを尤度最大化で推定することもできるってことか。それで、6.4.4 節は、その応用(?)みたいな感じで、各訓練データ点からの寄与度を推定することで、役に立たないゴミみたいなデータを除けるって話だな。