グラフィカルモデルがどう便利なのかよくわからないのでこの本を読みます。

| Probabilistic Graphical Models: Principles and Techniques (Adaptive Computation and Machine Learning series) Daphne Koller Nir Friedman The MIT Press 2009-07-31 売り上げランキング : 1404 Amazonで詳しく見る by G-Tools |

読んだページ: 1~5ページ

以下、メモと雑談。

- 何がしたいのか(1~2ページ):

- システムに、推論する(推論の定義 ≡ 使用可能な情報をつかって結論を出す)ことをさせたい。

- どんな問題も解決してくれるシステムをつくろうとするのは現実的ではない(あるタスクは上手く解決できたとしても別のタスクへ応用するときにはプログラムをかなり書き換えないといけないし、あるタスクを解決した知見が別のタスクへ応用しづらい)。

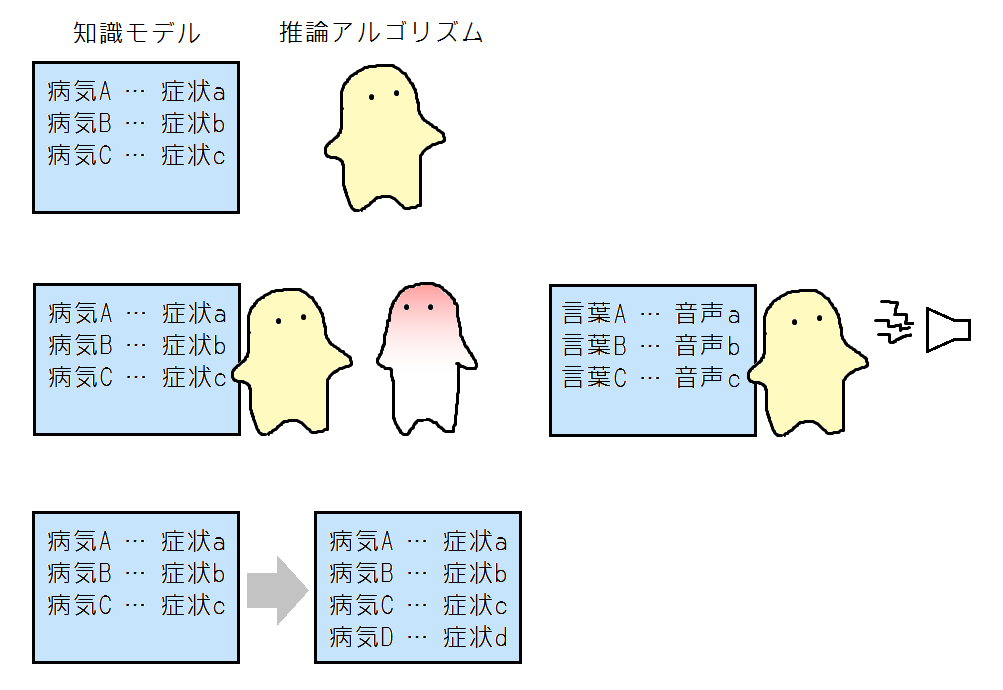

- そこで「知識モデル」と「推論アルゴリズム」を切り分けて考える(下図)。

- 推論の結論は「確率」が伴った形で与えさせるべき。現実世界では不確かさから逃れられないし、可能性だけを拾って「病気診断の結果ですが、患者さんの病気は次の573種類の可能性があります」じゃありがたくなさすぎる。

- 確率的モデルってどうやってつくるのか~確率的グラフィカルモデルへ(2~5ページ):

- 確率変数たち

の同時分布を求める。

- インフルエンザの診断の例なら、各確率変数は「インフルエンザかどうか(0 or 1)」「熱が何度あるか(連続値)」などになりうる。

- いまインフルエンザと花粉症だけを考えて、確率変数として「インフルエンザか」「花粉症か」「季節(4値)」「充血があるか」「筋肉の痛みがあるか」のみを考えると、2×2×4×2×2=64 個の見本点があることになる。だいぶ簡単化した例でもこれだけ多いので、一般的な病気診断を考えると途方もない。

- そこで確率的グラフィカルモデルの枠組みを導入して、確率変数間の依存構造だけ抜き出してコンパクトに表現し、実利用しやすくすると。

- ベイジアンネットワークとマルコフネットワークのグラフ表現の例: このグラフから確率変数間の独立性と、同時分布の因子分解が示唆される(どんな独立性をもつかとどう因子分解できるかは同値だが)。

- 上図左のグラフ構造が示唆する独立性:

(屍人 ⊥ 闇人|怪異)≡ 怪異があったかどうかgivenの下で屍人かどうかと闇人かどうかは独立

(不死身 ⊥ 怪異|屍人,闇人)

(目から赤い水 ⊥ 闇人,不死身|屍人)

(目から赤い水 ⊥ 不死身|屍人) - 上図左のグラフ構造の因子分解:

P(怪異,屍人,闇人,不死身,赤い水)

=P(怪異)P(屍人|怪異)P(闇人|怪異)P(不死身|屍人,闇人)P(赤い水|屍人) - 上図右のグラフ構造が示唆する独立性:

(単一タイプ ⊥ 5文字|図鑑No.が6の約数,最終進化形)

(図鑑No.が6の約数 ⊥ 最終進化形|単一タイプ,5文字) - 上図右のグラフ構造の因子分解:

P(単一タイプ,5文字,図鑑No.が6の約数,最終進化形)

=1/Z × φ_1(単一タイプ,最終進化形)× φ_2(最終進化形,5文字)

× φ_3(5文字,図鑑No.が6の約数)× φ_4(図鑑No.が6の約数,単一タイプ)

- 上図左のグラフ構造が示唆する独立性:

- 確率変数たち

- “probabilistic rug”(2ページ):「確率的じゅうたん」(?)。世の中には可能性はたくさんあるので全ての確率を考えるのは大変だけど、モデルの上では起こりにくい無数の例外は「その他のレアケース」としてじゅうたんの下に掃除してしまえるよとのこと。ここでじゅうたんへの喩えが要るのだろうか。あとゴミはじゅうたんの下じゃなくゴミ箱へ。

ちなみにマルコフネットワークの例の独立性は破綻していない(証明略)。